👉模型列表详情

* 中文识别模型

| 模型 | 模型下载链接 |

识别 Avg Accuracy(%) |

GPU推理耗时(ms) |

CPU推理耗时 (ms) |

模型存储大小(M) |

介绍 |

| PP-OCRv4_server_rec_doc | 推理模型/训练模型 |

81.53 |

|

|

74.7 M |

PP-OCRv4_server_rec_doc是在PP-OCRv4_server_rec的基础上,在更多中文文档数据和PP-OCR训练数据的混合数据训练而成,增加了部分繁体字、日文、特殊字符的识别能力,可支持识别的字符为1.5万+,除文档相关的文字识别能力提升外,也同时提升了通用文字的识别能力 |

| PP-OCRv4_mobile_rec | 推理模型/训练模型 |

78.74 |

7.95018 |

46.7868 |

10.6 M |

PP-OCRv4的轻量级识别模型,推理效率高,可以部署在包含端侧设备的多种硬件设备中 |

| PP-OCRv4_server_rec | 推理模型/训练模型 |

80.61 |

7.19439 |

140.179 |

71.2 M |

PP-OCRv4的服务器端模型,推理精度高,可以部署在多种不同的服务器上 |

| PP-OCRv3_mobile_rec | 推理模型/训练模型 |

72.96 |

|

|

9.2 M |

PP-OCRv3的轻量级识别模型,推理效率高,可以部署在包含端侧设备的多种硬件设备中 |

注:以上精度指标的评估集是 PaddleOCR 自建的中文数据集,覆盖街景、网图、文档、手写多个场景,其中文本识别包含 8367 张图片。所有模型 GPU 推理耗时基于 NVIDIA Tesla T4 机器,精度类型为 FP32, CPU 推理速度基于 Intel(R) Xeon(R) Gold 5117 CPU @ 2.00GHz,线程数为8,精度类型为 FP32。

| 模型 | 模型下载链接 |

识别 Avg Accuracy(%) |

GPU推理耗时(ms) |

CPU推理耗时 |

模型存储大小(M) |

介绍 |

| ch_SVTRv2_rec | 推理模型/训练模型 |

68.81 |

8.36801 |

165.706 |

73.9 M |

SVTRv2 是一种由复旦大学视觉与学习实验室(FVL)的OpenOCR团队研发的服务端文本识别模型,其在PaddleOCR算法模型挑战赛 - 赛题一:OCR端到端识别任务中荣获一等奖,A榜端到端识别精度相比PP-OCRv4提升6%。

|

注:以上精度指标的评估集是 PaddleOCR算法模型挑战赛 - 赛题一:OCR端到端识别任务A榜。 所有模型 GPU 推理耗时基于 NVIDIA Tesla T4 机器,精度类型为 FP32, CPU 推理速度基于 Intel(R) Xeon(R) Gold 5117 CPU @ 2.00GHz,线程数为8,精度类型为 FP32。

| 模型 | 模型下载链接 |

识别 Avg Accuracy(%) |

GPU推理耗时(ms) |

CPU推理耗时 |

模型存储大小(M) |

介绍 |

| ch_RepSVTR_rec | 推理模型/训练模型 |

65.07 |

10.5047 |

51.5647 |

22.1 M |

RepSVTR 文本识别模型是一种基于SVTRv2 的移动端文本识别模型,其在PaddleOCR算法模型挑战赛 - 赛题一:OCR端到端识别任务中荣获一等奖,B榜端到端识别精度相比PP-OCRv4提升2.5%,推理速度持平。 |

注:以上精度指标的评估集是 PaddleOCR算法模型挑战赛 - 赛题一:OCR端到端识别任务B榜。 所有模型 GPU 推理耗时基于 NVIDIA Tesla T4 机器,精度类型为 FP32, CPU 推理速度基于 Intel(R) Xeon(R) Gold 5117 CPU @ 2.00GHz,线程数为8,精度类型为 FP32。

* 英文识别模型

| 模型 | 模型下载链接 |

识别 Avg Accuracy(%) |

GPU推理耗时(ms) |

CPU推理耗时 |

模型存储大小(M) |

介绍 |

| en_PP-OCRv4_mobile_rec | 推理模型/训练模型 |

70.39 |

|

|

6.8 M |

基于PP-OCRv4识别模型训练得到的超轻量英文识别模型,支持英文、数字识别 |

| en_PP-OCRv3_mobile_rec | 推理模型/训练模型 |

70.69 |

|

|

7.8 M |

基于PP-OCRv3识别模型训练得到的超轻量英文识别模型,支持英文、数字识别 |

* 多语言识别模型

| 模型 | 模型下载链接 |

识别 Avg Accuracy(%) |

GPU推理耗时(ms) |

CPU推理耗时 |

模型存储大小(M) |

介绍 |

| korean_PP-OCRv3_mobile_rec | 推理模型/训练模型 |

60.21 |

|

|

8.6 M |

基于PP-OCRv3识别模型训练得到的超轻量韩文识别模型,支持韩文、数字识别 |

| japan_PP-OCRv3_mobile_rec | 推理模型/训练模型 |

45.69 |

|

|

8.8 M |

基于PP-OCRv3识别模型训练得到的超轻量日文识别模型,支持日文、数字识别 |

| chinese_cht_PP-OCRv3_mobile_rec | 推理模型/训练模型 |

82.06 |

|

|

9.7 M |

基于PP-OCRv3识别模型训练得到的超轻量繁体中文识别模型,支持繁体中文、数字识别 |

| te_PP-OCRv3_mobile_rec | 推理模型/训练模型 |

95.88 |

|

|

7.8 M |

基于PP-OCRv3识别模型训练得到的超轻量泰卢固文识别模型,支持泰卢固文、数字识别 |

| ka_PP-OCRv3_mobile_rec | 推理模型/训练模型 |

96.96 |

|

|

8.0 M |

基于PP-OCRv3识别模型训练得到的超轻量卡纳达文识别模型,支持卡纳达文、数字识别 |

| ta_PP-OCRv3_mobile_rec | 推理模型/训练模型 |

76.83 |

|

|

8.0 M |

基于PP-OCRv3识别模型训练得到的超轻量泰米尔文识别模型,支持泰米尔文、数字识别 |

| latin_PP-OCRv3_mobile_rec | 推理模型/训练模型 |

76.93 |

|

|

7.8 M |

基于PP-OCRv3识别模型训练得到的超轻量拉丁文识别模型,支持拉丁文、数字识别 |

| arabic_PP-OCRv3_mobile_rec | 推理模型/训练模型 |

73.55 |

|

|

7.8 M |

基于PP-OCRv3识别模型训练得到的超轻量阿拉伯字母识别模型,支持阿拉伯字母、数字识别 |

| cyrillic_PP-OCRv3_mobile_rec | 推理模型/训练模型 |

94.28 |

|

|

7.9 M |

基于PP-OCRv3识别模型训练得到的超轻量斯拉夫字母识别模型,支持斯拉夫字母、数字识别 |

| devanagari_PP-OCRv3_mobile_rec | 推理模型/训练模型 |

96.44 |

|

|

7.9 M |

基于PP-OCRv3识别模型训练得到的超轻量梵文字母识别模型,支持梵文字母、数字识别 |

注:以上精度指标的评估集是 PaddleX 自建的多语种数据集。 所有模型 GPU 推理耗时基于 NVIDIA Tesla T4 机器,精度类型为 FP32, CPU 推理速度基于 Intel(R) Xeon(R) Gold 5117 CPU @ 2.00GHz,线程数为8,精度类型为 FP32。

| 参数 |

参数说明 |

参数类型 |

可选项 |

默认值 |

input |

待预测数据,支持多种输入类型,必填 |

Python Var|str|list |

- Python Var:如

numpy.ndarray 表示的图像数据

- str:如图像文件或者PDF文件的本地路径:

/root/data/img.jpg;如URL链接,如图像文件或PDF文件的网络URL:示例;如本地目录,该目录下需包含待预测图像,如本地路径:/root/data/(当前不支持目录中包含PDF文件的预测,PDF文件需要指定到具体文件路径)

- List:列表元素需为上述类型数据,如

[numpy.ndarray, numpy.ndarray],[\"/root/data/img1.jpg\", \"/root/data/img2.jpg\"],[\"/root/data1\", \"/root/data2\"]

|

None |

device |

产线推理设备 |

str|None |

- CPU:如

cpu 表示使用 CPU 进行推理;

- GPU:如

gpu:0 表示使用第 1 块 GPU 进行推理;

- NPU:如

npu:0 表示使用第 1 块 NPU 进行推理;

- XPU:如

xpu:0 表示使用第 1 块 XPU 进行推理;

- MLU:如

mlu:0 表示使用第 1 块 MLU 进行推理;

- DCU:如

dcu:0 表示使用第 1 块 DCU 进行推理;

- None:如果设置为

None, 将默认使用产线初始化的该参数值,初始化时,会优先使用本地的 GPU 0号设备,如果没有,则使用 CPU 设备;

|

None |

use_doc_orientation_classify |

是否使用文档方向分类模块 |

bool|None |

- bool:

True 或者 False;

- None:如果设置为

None, 将默认使用产线初始化的该参数值,初始化为True;

|

None |

use_doc_unwarping |

是否使用文档扭曲矫正模块 |

bool|None |

- bool:

True 或者 False;

- None:如果设置为

None, 将默认使用产线初始化的该参数值,初始化为True;

|

None |

use_textline_orientation |

是否使用文本行方向分类模块 |

bool|None |

- bool:

True 或者 False;

- None:如果设置为

None, 将默认使用产线初始化的该参数值,初始化为True;

|

None |

text_det_limit_side_len |

文本检测的图像边长限制 |

int|None |

- int:大于

0 的任意整数;

- None:如果设置为

None, 将默认使用产线初始化的该参数值,初始化为 960;

|

None |

text_det_limit_type |

文本检测的图像边长限制类型 |

str|None |

- str:支持

min 和 max,min 表示保证图像最短边不小于 det_limit_side_len,max 表示保证图像最长边不大于 limit_side_len

- None:如果设置为

None, 将默认使用产线初始化的该参数值,初始化为 max;

|

None |

text_det_thresh |

检测像素阈值,输出的概率图中,得分大于该阈值的像素点才会被认为是文字像素点 |

float|None |

- float:大于

0 的任意浮点数

- None:如果设置为

None, 将默认使用产线初始化的该参数值 0.3 |

None |

text_det_box_thresh |

检测框阈值,检测结果边框内,所有像素点的平均得分大于该阈值时,该结果会被认为是文字区域 |

float|None |

- float:大于

0 的任意浮点数

- None:如果设置为

None, 将默认使用产线初始化的该参数值 0.6 |

None |

text_det_unclip_ratio |

文本检测扩张系数,使用该方法对文字区域进行扩张,该值越大,扩张的面积越大 |

float|None |

- float:大于

0 的任意浮点数

- None:如果设置为

None, 将默认使用产线初始化的该参数值 2.0 |

None |

text_rec_score_thresh |

文本识别阈值,得分大于该阈值的文本结果会被保留 |

float|None |

- float:大于

0 的任意浮点数

- None:如果设置为

None, 将默认使用产线初始化的该参数值 0.0。即不设阈值 |

None |

(3)对预测结果进行处理,每个样本的预测结果均为`dict`类型,且支持打印、保存为图片、保存为`json`文件的操作:

API参考

对于服务提供的主要操作:

- HTTP请求方法为POST。

- 请求体和响应体均为JSON数据(JSON对象)。

- 当请求处理成功时,响应状态码为

200,响应体的属性如下:

| 名称 |

类型 |

含义 |

logId |

string |

请求的UUID。 |

errorCode |

integer |

错误码。固定为0。 |

errorMsg |

string |

错误说明。固定为"Success"。 |

result |

object |

操作结果。 |

| 名称 |

类型 |

含义 |

logId |

string |

请求的UUID。 |

errorCode |

integer |

错误码。与响应状态码相同。 |

errorMsg |

string |

错误说明。 |

服务提供的主要操作如下:

获取图像OCR结果。

POST /ocr

| 名称 |

类型 |

含义 |

是否必填 |

image |

string |

服务可访问的图像文件的URL或图像文件内容的Base64编码结果。 |

是 |

inferenceParams |

object |

推理参数。 |

否 |

inferenceParams的属性如下:

| 名称 |

类型 |

含义 |

是否必填 |

maxLongSide |

integer |

推理时,若文本检测模型的输入图像较长边的长度大于maxLongSide,则将对图像进行缩放,使其较长边的长度等于maxLongSide。 |

否 |

- 请求处理成功时,响应体的

result具有如下属性:

| 名称 |

类型 |

含义 |

texts |

array |

文本位置、内容和得分。 |

image |

string |

OCR结果图,其中标注检测到的文本位置。图像为JPEG格式,使用Base64编码。 |

texts中的每个元素为一个object,具有如下属性:

| 名称 |

类型 |

含义 |

poly |

array |

文本位置。数组中元素依次为包围文本的多边形的顶点坐标。 |

text |

string |

文本内容。 |

score |

number |

文本识别得分。 |

result示例如下:

{

"texts": [

{

"poly": [

[

444,

244

],

[

705,

244

],

[

705,

311

],

[

444,

311

]

],

"text": "北京南站",

"score": 0.9

},

{

"poly": [

[

992,

248

],

[

1263,

251

],

[

1263,

318

],

[

992,

315

]

],

"text": "天津站",

"score": 0.5

}

],

"image": "xxxxxx"

}

多语言调用服务示例

Python

import base64

import requests

API_URL = "http://localhost:8080/ocr" # 服务URL

image_path = "./demo.jpg"

output_image_path = "./out.jpg"

# 对本地图像进行Base64编码

with open(image_path, "rb") as file:

image_bytes = file.read()

image_data = base64.b64encode(image_bytes).decode("ascii")

payload = {"image": image_data} # Base64编码的文件内容或者图像URL

# 调用API

response = requests.post(API_URL, json=payload)

# 处理接口返回数据

assert response.status_code == 200

result = response.json()["result"]

with open(output_image_path, "wb") as file:

file.write(base64.b64decode(result["image"]))

print(f"Output image saved at {output_image_path}")

print("\nDetected texts:")

print(result["texts"])

C++

#include <iostream>

#include "cpp-httplib/httplib.h" // https://github.com/Huiyicc/cpp-httplib

#include "nlohmann/json.hpp" // https://github.com/nlohmann/json

#include "base64.hpp" // https://github.com/tobiaslocker/base64

int main() {

httplib::Client client("localhost:8080");

const std::string imagePath = "./demo.jpg";

const std::string outputImagePath = "./out.jpg";

httplib::Headers headers = {

{"Content-Type", "application/json"}

};

// 对本地图像进行Base64编码

std::ifstream file(imagePath, std::ios::binary | std::ios::ate);

std::streamsize size = file.tellg();

file.seekg(0, std::ios::beg);

std::vector<char> buffer(size);

if (!file.read(buffer.data(), size)) {

std::cerr << "Error reading file." << std::endl;

return 1;

}

std::string bufferStr(reinterpret_cast<const char*>(buffer.data()), buffer.size());

std::string encodedImage = base64::to_base64(bufferStr);

nlohmann::json jsonObj;

jsonObj["image"] = encodedImage;

std::string body = jsonObj.dump();

// 调用API

auto response = client.Post("/ocr", headers, body, "application/json");

// 处理接口返回数据

if (response && response->status == 200) {

nlohmann::json jsonResponse = nlohmann::json::parse(response->body);

auto result = jsonResponse["result"];

encodedImage = result["image"];

std::string decodedString = base64::from_base64(encodedImage);

std::vector<unsigned char> decodedImage(decodedString.begin(), decodedString.end());

std::ofstream outputImage(outPutImagePath, std::ios::binary | std::ios::out);

if (outputImage.is_open()) {

outputImage.write(reinterpret_cast<char*>(decodedImage.data()), decodedImage.size());

outputImage.close();

std::cout << "Output image saved at " << outPutImagePath << std::endl;

} else {

std::cerr << "Unable to open file for writing: " << outPutImagePath << std::endl;

}

auto texts = result["texts"];

std::cout << "\nDetected texts:" << std::endl;

for (const auto& text : texts) {

std::cout << text << std::endl;

}

} else {

std::cout << "Failed to send HTTP request." << std::endl;

return 1;

}

return 0;

}

Java

import okhttp3.*;

import com.fasterxml.jackson.databind.ObjectMapper;

import com.fasterxml.jackson.databind.JsonNode;

import com.fasterxml.jackson.databind.node.ObjectNode;

import java.io.File;

import java.io.FileOutputStream;

import java.io.IOException;

import java.util.Base64;

public class Main {

public static void main(String[] args) throws IOException {

String API_URL = "http://localhost:8080/ocr"; // 服务URL

String imagePath = "./demo.jpg"; // 本地图像

String outputImagePath = "./out.jpg"; // 输出图像

// 对本地图像进行Base64编码

File file = new File(imagePath);

byte[] fileContent = java.nio.file.Files.readAllBytes(file.toPath());

String imageData = Base64.getEncoder().encodeToString(fileContent);

ObjectMapper objectMapper = new ObjectMapper();

ObjectNode params = objectMapper.createObjectNode();

params.put("image", imageData); // Base64编码的文件内容或者图像URL

// 创建 OkHttpClient 实例

OkHttpClient client = new OkHttpClient();

MediaType JSON = MediaType.Companion.get("application/json; charset=utf-8");

RequestBody body = RequestBody.Companion.create(params.toString(), JSON);

Request request = new Request.Builder()

.url(API_URL)

.post(body)

.build();

// 调用API并处理接口返回数据

try (Response response = client.newCall(request).execute()) {

if (response.isSuccessful()) {

String responseBody = response.body().string();

JsonNode resultNode = objectMapper.readTree(responseBody);

JsonNode result = resultNode.get("result");

String base64Image = result.get("image").asText();

JsonNode texts = result.get("texts");

byte[] imageBytes = Base64.getDecoder().decode(base64Image);

try (FileOutputStream fos = new FileOutputStream(outputImagePath)) {

fos.write(imageBytes);

}

System.out.println("Output image saved at " + outputImagePath);

System.out.println("\nDetected texts: " + texts.toString());

} else {

System.err.println("Request failed with code: " + response.code());

}

}

}

}

Go

package main

import (

"bytes"

"encoding/base64"

"encoding/json"

"fmt"

"io/ioutil"

"net/http"

)

func main() {

API_URL := "http://localhost:8080/ocr"

imagePath := "./demo.jpg"

outputImagePath := "./out.jpg"

// 对本地图像进行Base64编码

imageBytes, err := ioutil.ReadFile(imagePath)

if err != nil {

fmt.Println("Error reading image file:", err)

return

}

imageData := base64.StdEncoding.EncodeToString(imageBytes)

payload := map[string]string{"image": imageData} // Base64编码的文件内容或者图像URL

payloadBytes, err := json.Marshal(payload)

if err != nil {

fmt.Println("Error marshaling payload:", err)

return

}

// 调用API

client := &http.Client{}

req, err := http.NewRequest("POST", API_URL, bytes.NewBuffer(payloadBytes))

if err != nil {

fmt.Println("Error creating request:", err)

return

}

res, err := client.Do(req)

if err != nil {

fmt.Println("Error sending request:", err)

return

}

defer res.Body.Close()

// 处理接口返回数据

body, err := ioutil.ReadAll(res.Body)

if err != nil {

fmt.Println("Error reading response body:", err)

return

}

type Response struct {

Result struct {

Image string `json:"image"`

Texts []map[string]interface{} `json:"texts"`

} `json:"result"`

}

var respData Response

err = json.Unmarshal([]byte(string(body)), &respData)

if err != nil {

fmt.Println("Error unmarshaling response body:", err)

return

}

outputImageData, err := base64.StdEncoding.DecodeString(respData.Result.Image)

if err != nil {

fmt.Println("Error decoding base64 image data:", err)

return

}

err = ioutil.WriteFile(outputImagePath, outputImageData, 0644)

if err != nil {

fmt.Println("Error writing image to file:", err)

return

}

fmt.Printf("Image saved at %s.jpg\n", outputImagePath)

fmt.Println("\nDetected texts:")

for _, text := range respData.Result.Texts {

fmt.Println(text)

}

}

C#

using System;

using System.IO;

using System.Net.Http;

using System.Net.Http.Headers;

using System.Text;

using System.Threading.Tasks;

using Newtonsoft.Json.Linq;

class Program

{

static readonly string API_URL = "http://localhost:8080/ocr";

static readonly string imagePath = "./demo.jpg";

static readonly string outputImagePath = "./out.jpg";

static async Task Main(string[] args)

{

var httpClient = new HttpClient();

// 对本地图像进行Base64编码

byte[] imageBytes = File.ReadAllBytes(imagePath);

string image_data = Convert.ToBase64String(imageBytes);

var payload = new JObject{ { "image", image_data } }; // Base64编码的文件内容或者图像URL

var content = new StringContent(payload.ToString(), Encoding.UTF8, "application/json");

// 调用API

HttpResponseMessage response = await httpClient.PostAsync(API_URL, content);

response.EnsureSuccessStatusCode();

// 处理接口返回数据

string responseBody = await response.Content.ReadAsStringAsync();

JObject jsonResponse = JObject.Parse(responseBody);

string base64Image = jsonResponse["result"]["image"].ToString();

byte[] outputImageBytes = Convert.FromBase64String(base64Image);

File.WriteAllBytes(outputImagePath, outputImageBytes);

Console.WriteLine($"Output image saved at {outputImagePath}");

Console.WriteLine("\nDetected texts:");

Console.WriteLine(jsonResponse["result"]["texts"].ToString());

}

}

Node.js

const axios = require('axios');

const fs = require('fs');

const API_URL = 'http://localhost:8080/ocr'

const imagePath = './demo.jpg'

const outputImagePath = "./out.jpg";

let config = {

method: 'POST',

maxBodyLength: Infinity,

url: API_URL,

data: JSON.stringify({

'image': encodeImageToBase64(imagePath) // Base64编码的文件内容或者图像URL

})

};

// 对本地图像进行Base64编码

function encodeImageToBase64(filePath) {

const bitmap = fs.readFileSync(filePath);

return Buffer.from(bitmap).toString('base64');

}

// 调用API

axios.request(config)

.then((response) => {

// 处理接口返回数据

const result = response.data["result"];

const imageBuffer = Buffer.from(result["image"], 'base64');

fs.writeFile(outputImagePath, imageBuffer, (err) => {

if (err) throw err;

console.log(`Output image saved at ${outputImagePath}`);

});

console.log("\nDetected texts:");

console.log(result["texts"]);

})

.catch((error) => {

console.log(error);

});

PHP

<?php

$API_URL = "http://localhost:8080/ocr"; // 服务URL

$image_path = "./demo.jpg";

$output_image_path = "./out.jpg";

// 对本地图像进行Base64编码

$image_data = base64_encode(file_get_contents($image_path));

$payload = array("image" => $image_data); // Base64编码的文件内容或者图像URL

// 调用API

$ch = curl_init($API_URL);

curl_setopt($ch, CURLOPT_POST, true);

curl_setopt($ch, CURLOPT_POSTFIELDS, json_encode($payload));

curl_setopt($ch, CURLOPT_HTTPHEADER, array('Content-Type: application/json'));

curl_setopt($ch, CURLOPT_RETURNTRANSFER, true);

$response = curl_exec($ch);

curl_close($ch);

// 处理接口返回数据

$result = json_decode($response, true)["result"];

file_put_contents($output_image_path, base64_decode($result["image"]));

echo "Output image saved at " . $output_image_path . "\n";

echo "\nDetected texts:\n";

print_r($result["texts"]);

?>

通用OCR产线中包含必选的文本检测模块和文本识别模块,以及可选的文档图像方向分类模块、文本图像矫正模块和文本行方向分类模块。其中,文档图像方向分类模块和文本图像矫正模块作为文档预处理子产线被集成到通用OCR产线中。每个模块都包含多个模型,您可以根据下方的基准测试数据选择使用的模型。

如果您更注重模型的精度,请选择精度较高的模型;如果您更在意模型的推理速度,请选择推理速度较快的模型;如果您关注模型的存储大小,请选择存储体积较小的模型。

通用OCR产线中包含必选的文本检测模块和文本识别模块,以及可选的文档图像方向分类模块、文本图像矫正模块和文本行方向分类模块。其中,文档图像方向分类模块和文本图像矫正模块作为文档预处理子产线被集成到通用OCR产线中。每个模块都包含多个模型,您可以根据下方的基准测试数据选择使用的模型。

如果您更注重模型的精度,请选择精度较高的模型;如果您更在意模型的推理速度,请选择推理速度较快的模型;如果您关注模型的存储大小,请选择存储体积较小的模型。

如果您对产线运行的效果满意,可以直接进行集成部署。您可以选择从云端下载部署包,也可以参考[2.2节本地体验](#22-本地体验)中的方法进行本地部署。如果对效果不满意,您可以利用私有数据对产线中的模型进行微调训练。如果您具备本地训练的硬件资源,可以直接在本地开展训练;如果没有,星河零代码平台提供了一键式训练服务,无需编写代码,只需上传数据后,即可一键启动训练任务。

### 2.2 本地体验

> ❗ 在本地使用通用OCR产线前,请确保您已经按照[PaddleX安装教程](../../../installation/installation.md)完成了PaddleX的wheel包安装。

#### 2.2.1 命令行方式体验

* 一行命令即可快速体验OCR产线效果,使用 [测试文件](https://paddle-model-ecology.bj.bcebos.com/paddlex/imgs/demo_image/general_ocr_002.png),并将 `--input` 替换为本地路径,进行预测

```bash

paddlex --pipeline OCR \

--input general_ocr_002.png \

--use_doc_orientation_classify False \

--use_doc_unwarping False \

--use_textline_orientation False \

--save_path ./output \

--device gpu:0

```

相关的参数说明可以参考[2.2.2 Python脚本方式集成](#222-python脚本方式集成)中的参数说明。

运行后,会将结果打印到终端上,结果如下:

```bash

{'res': {'input_path': 'general_ocr_002.png', 'model_settings': {'use_doc_preprocessor': False, 'use_textline_orientation': False}, 'doc_preprocessor_res': {'input_path': '0.jpg', 'model_settings': {'use_doc_orientation_classify': True, 'use_doc_unwarping': False}, 'angle': 0},'dt_polys': [array([[ 3, 10],

[82, 10],

[82, 33],

[ 3, 33]], dtype=int16), ...], 'text_det_params': {'limit_side_len': 960, 'limit_type': 'max', 'thresh': 0.3, 'box_thresh': 0.6, 'unclip_ratio': 2.0}, 'text_type': 'general', 'textline_orientation_angles': [-1, ...], 'text_rec_score_thresh': 0.0, 'rec_texts': ['www.99*', ...], 'rec_scores': [0.8980069160461426, ...], 'rec_polys': [array([[ 3, 10],

[82, 10],

[82, 33],

[ 3, 33]], dtype=int16), ...], 'rec_boxes': array([[ 3, 10, 82, 33], ...], dtype=int16)}}

```

运行结果参数说明可以参考[2.2.2 Python脚本方式集成](#222-python脚本方式集成)中的结果解释。

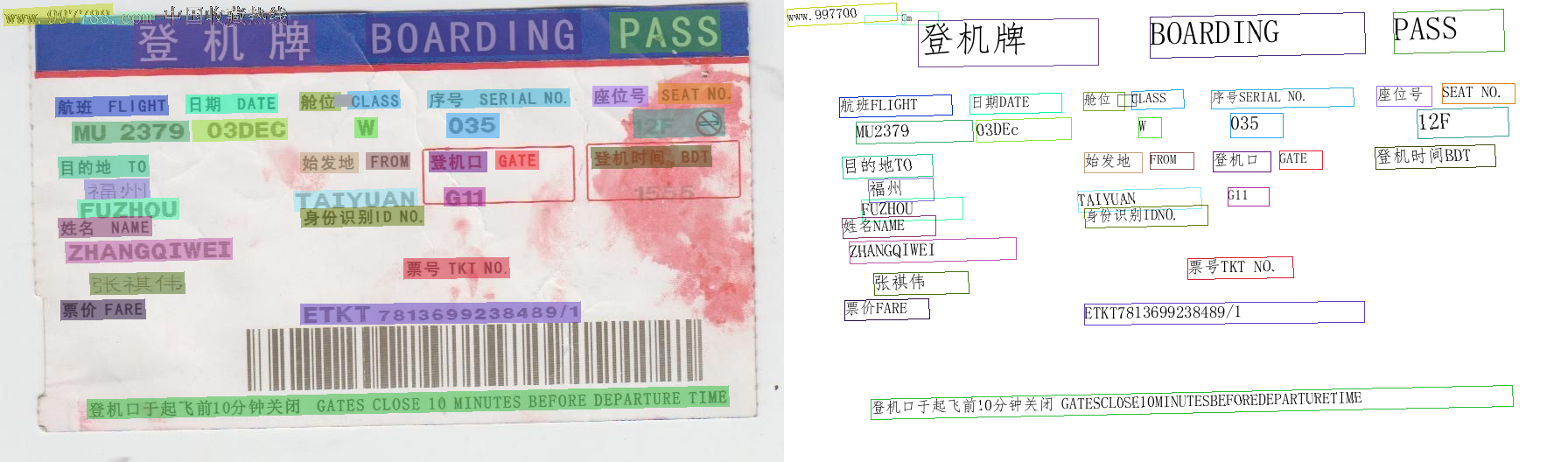

可视化结果保存在`save_path`下,其中OCR的可视化结果如下:

如果您对产线运行的效果满意,可以直接进行集成部署。您可以选择从云端下载部署包,也可以参考[2.2节本地体验](#22-本地体验)中的方法进行本地部署。如果对效果不满意,您可以利用私有数据对产线中的模型进行微调训练。如果您具备本地训练的硬件资源,可以直接在本地开展训练;如果没有,星河零代码平台提供了一键式训练服务,无需编写代码,只需上传数据后,即可一键启动训练任务。

### 2.2 本地体验

> ❗ 在本地使用通用OCR产线前,请确保您已经按照[PaddleX安装教程](../../../installation/installation.md)完成了PaddleX的wheel包安装。

#### 2.2.1 命令行方式体验

* 一行命令即可快速体验OCR产线效果,使用 [测试文件](https://paddle-model-ecology.bj.bcebos.com/paddlex/imgs/demo_image/general_ocr_002.png),并将 `--input` 替换为本地路径,进行预测

```bash

paddlex --pipeline OCR \

--input general_ocr_002.png \

--use_doc_orientation_classify False \

--use_doc_unwarping False \

--use_textline_orientation False \

--save_path ./output \

--device gpu:0

```

相关的参数说明可以参考[2.2.2 Python脚本方式集成](#222-python脚本方式集成)中的参数说明。

运行后,会将结果打印到终端上,结果如下:

```bash

{'res': {'input_path': 'general_ocr_002.png', 'model_settings': {'use_doc_preprocessor': False, 'use_textline_orientation': False}, 'doc_preprocessor_res': {'input_path': '0.jpg', 'model_settings': {'use_doc_orientation_classify': True, 'use_doc_unwarping': False}, 'angle': 0},'dt_polys': [array([[ 3, 10],

[82, 10],

[82, 33],

[ 3, 33]], dtype=int16), ...], 'text_det_params': {'limit_side_len': 960, 'limit_type': 'max', 'thresh': 0.3, 'box_thresh': 0.6, 'unclip_ratio': 2.0}, 'text_type': 'general', 'textline_orientation_angles': [-1, ...], 'text_rec_score_thresh': 0.0, 'rec_texts': ['www.99*', ...], 'rec_scores': [0.8980069160461426, ...], 'rec_polys': [array([[ 3, 10],

[82, 10],

[82, 33],

[ 3, 33]], dtype=int16), ...], 'rec_boxes': array([[ 3, 10, 82, 33], ...], dtype=int16)}}

```

运行结果参数说明可以参考[2.2.2 Python脚本方式集成](#222-python脚本方式集成)中的结果解释。

可视化结果保存在`save_path`下,其中OCR的可视化结果如下:

#### 2.2.2 Python脚本方式集成

* 上述命令行是为了快速体验查看效果,一般来说,在项目中,往往需要通过代码集成,您可以通过几行代码即可完成产线的快速推理,推理代码如下:

```python

from paddlex import create_pipeline

pipeline = create_pipeline(pipeline="OCR")

output = pipeline.predict(

input="./general_ocr_002.png",

use_doc_orientation_classify=False,

use_doc_unwarping=False,

use_textline_orientation=False,

)

for res in output:

res.print()

res.save_to_img(save_path="./output/")

res.save_to_json(save_path="./output/")

```

在上述 Python 脚本中,执行了如下几个步骤:

(1)通过 `create_pipeline()` 实例化 OCR 产线对象,具体参数说明如下:

#### 2.2.2 Python脚本方式集成

* 上述命令行是为了快速体验查看效果,一般来说,在项目中,往往需要通过代码集成,您可以通过几行代码即可完成产线的快速推理,推理代码如下:

```python

from paddlex import create_pipeline

pipeline = create_pipeline(pipeline="OCR")

output = pipeline.predict(

input="./general_ocr_002.png",

use_doc_orientation_classify=False,

use_doc_unwarping=False,

use_textline_orientation=False,

)

for res in output:

res.print()

res.save_to_img(save_path="./output/")

res.save_to_json(save_path="./output/")

```

在上述 Python 脚本中,执行了如下几个步骤:

(1)通过 `create_pipeline()` 实例化 OCR 产线对象,具体参数说明如下: