---

comments: true

---

# 版面区域检测模块使用教程

## 一、概述

版面区域检测任务的核心是对输入的文档图像进行内容解析和区域划分。通过识别图像中的不同元素(如文字、图表、图像、公式、段落、摘要、参考文献等),将其归类为预定义的类别,并确定这些区域在文档中的位置。

## 二、支持模型列表

* 版面检测模型,包含23个常见的类别:文档标题、段落标题、文本、页码、摘要、目录、参考文献、脚注、页眉、页脚、算法、公式、公式编号、图像、图表标题、表格、表格标题、印章、图表标题、图表、页眉图像、页脚图像、侧栏文本

| 模型 | 模型下载链接 |

mAP(0.5)(%) |

GPU推理耗时(ms) |

CPU推理耗时 (ms) |

模型存储大小(M) |

介绍 |

| PP-DocLayout-L | 推理模型/训练模型 |

90.4 |

34.5252 |

1454.27 |

123.76 M |

基于RT-DETR-L在包含中英文论文、杂志、合同、书本、试卷和研报等场景的自建数据集训练的高精度版面区域定位模型 |

| PP-DocLayout-M | 推理模型/训练模型 |

75.2 |

15.9 |

160.1 |

22.578 |

基于PicoDet-L在包含中英文论文、杂志、合同、书本、试卷和研报等场景的自建数据集训练的精度效率平衡的版面区域定位模型 |

| PP-DocLayout-S | 推理模型/训练模型 |

70.9 |

13.8 |

46.7 |

4.834 |

基于PicoDet-S在中英文论文、杂志、合同、书本、试卷和研报等场景上自建数据集训练的高效率版面区域定位模型 |

注:以上精度指标的评估集是 PaddleOCR 自建的版面区域检测数据集,包含中英文论文、杂志、合同、书本、试卷和研报等常见的 500 张文档类型图片。GPU 推理耗时基于 NVIDIA Tesla T4 机器,精度类型为 FP32, CPU 推理速度基于 Intel(R) Xeon(R) Gold 5117 CPU @ 2.00GHz,线程数为 8,精度类型为 FP32。

> ❗ 以上列出的是版面检测模块重点支持的3个核心模型,该模块总共支持11个全量模型,包含多个预定义了不同类别的模型,完整的模型列表如下:

👉模型列表详情

* 表格版面检测模型

| 模型 | 模型下载链接 |

mAP(0.5)(%) |

GPU推理耗时(ms) |

CPU推理耗时 (ms) |

模型存储大小(M) |

介绍 |

| PicoDet_layout_1x_table | 推理模型/训练模型 |

97.5 |

12.623 |

90.8934 |

7.4 M |

基于PicoDet-1x在自建数据集训练的高效率版面区域定位模型,可定位表格这1类区域 |

注:以上精度指标的评估集是 PaddleOCR 自建的版面表格区域检测数据集,包含中英文 7835 张带有表格的论文文档类型图片。GPU 推理耗时基于 NVIDIA Tesla T4 机器,精度类型为 FP32, CPU 推理速度基于 Intel(R) Xeon(R) Gold 5117 CPU @ 2.00GHz,线程数为 8,精度类型为 FP32。

* 3类版面检测模型,包含表格、图像、印章

| 模型 | 模型下载链接 |

mAP(0.5)(%) |

GPU推理耗时(ms) |

CPU推理耗时 (ms) |

模型存储大小(M) |

介绍 |

| PicoDet-S_layout_3cls | 推理模型/训练模型 |

88.2 |

13.5 |

45.8 |

4.8 |

基于PicoDet-S轻量模型在中英文论文、杂志和研报等场景上自建数据集训练的高效率版面区域定位模型 |

| PicoDet-L_layout_3cls | 推理模型/训练模型 |

89.0 |

15.7 |

159.8 |

22.6 |

基于PicoDet-L在中英文论文、杂志和研报等场景上自建数据集训练的效率精度均衡版面区域定位模型 |

| RT-DETR-H_layout_3cls | 推理模型/训练模型 |

95.8 |

114.6 |

3832.6 |

470.1 |

基于RT-DETR-H在中英文论文、杂志和研报等场景上自建数据集训练的高精度版面区域定位模型 |

注:以上精度指标的评估集是 PaddleOCR 自建的版面区域检测数据集,包含中英文论文、杂志和研报等常见的 1154 张文档类型图片。GPU 推理耗时基于 NVIDIA Tesla T4 机器,精度类型为 FP32, CPU 推理速度基于 Intel(R) Xeon(R) Gold 5117 CPU @ 2.00GHz,线程数为 8,精度类型为 FP32。

* 5类英文文档区域检测模型,包含文字、标题、表格、图片以及列表

| 模型 | 模型下载链接 |

mAP(0.5)(%) |

GPU推理耗时(ms) |

CPU推理耗时 (ms) |

模型存储大小(M) |

介绍 |

| PicoDet_layout_1x | 推理模型/训练模型 |

97.8 |

13.0 |

91.3 |

7.4 |

基于PicoDet-1x在PubLayNet数据集训练的高效率英文文档版面区域定位模型 |

注:以上精度指标的评估集是 [PubLayNet](https://developer.ibm.com/exchanges/data/all/publaynet/) 的评估数据集,包含英文文档的 11245 张文图片。GPU 推理耗时基于 NVIDIA Tesla T4 机器,精度类型为 FP32, CPU 推理速度基于 Intel(R) Xeon(R) Gold 5117 CPU @ 2.00GHz,线程数为 8,精度类型为 FP32。

* 17类区域检测模型,包含17个版面常见类别,分别是:段落标题、图片、文本、数字、摘要、内容、图表标题、公式、表格、表格标题、参考文献、文档标题、脚注、页眉、算法、页脚、印章

| 模型 | 模型下载链接 |

mAP(0.5)(%) |

GPU推理耗时(ms) |

CPU推理耗时 (ms) |

模型存储大小(M) |

介绍 |

| PicoDet-S_layout_17cls | 推理模型/训练模型 |

87.4 |

13.6 |

46.2 |

4.8 |

基于PicoDet-S轻量模型在中英文论文、杂志和研报等场景上自建数据集训练的高效率版面区域定位模型 |

| PicoDet-L_layout_17cls | 推理模型/训练模型 |

89.0 |

17.2 |

160.2 |

22.6 |

基于PicoDet-L在中英文论文、杂志和研报等场景上自建数据集训练的效率精度均衡版面区域定位模型 |

| RT-DETR-H_layout_17cls | 推理模型/训练模型 |

98.3 |

115.1 |

3827.2 |

470.2 |

基于RT-DETR-H在中英文论文、杂志和研报等场景上自建数据集训练的高精度版面区域定位模型 |

注:以上精度指标的评估集是 PaddleOCR 自建的版面区域检测数据集,包含中英文论文、杂志和研报等常见的 892 张文档类型图片。GPU 推理耗时基于 NVIDIA Tesla T4 机器,精度类型为 FP32, CPU 推理速度基于 Intel(R) Xeon(R) Gold 5117 CPU @ 2.00GHz,线程数为 8,精度类型为 FP32。

👉 运行后,得到的结果为:(点击展开)

```bash

{'res': {'input_path': 'layout.jpg', 'boxes': [{'cls_id': 8, 'label': 'table', 'score': 0.9866330623626709, 'coordinate': [74.30874633789062, 105.7123031616211, 321.9883728027344, 299.10858154296875]}, {'cls_id': 2, 'label': 'text', 'score': 0.9859815835952759, 'coordinate': [34.65811538696289, 349.9101867675781, 358.3383483886719, 611.3431396484375]}, {'cls_id': 2, 'label': 'text', 'score': 0.9850621223449707, 'coordinate': [34.94462203979492, 647.3794555664062, 358.3255920410156, 849.2332763671875]}, {'cls_id': 8, 'label': 'table', 'score': 0.9850116968154907, 'coordinate': [438.06829833984375, 105.3771743774414, 662.88720703125, 313.8873291015625]}, {'cls_id': 2, 'label': 'text', 'score': 0.9847850799560547, 'coordinate': [385.97052001953125, 497.03924560546875, 710.9548950195312, 697.6804809570312]}, {'cls_id': 2, 'label': 'text', 'score': 0.9805687665939331, 'coordinate': [385.7969665527344, 345.9375305175781, 710.0733642578125, 459.14373779296875]}, {'cls_id': 2, 'label': 'text', 'score': 0.9799897074699402, 'coordinate': [386.07574462890625, 735.3798217773438, 710.6078491210938, 850.2001953125]}, {'cls_id': 9, 'label': 'table_title', 'score': 0.9375936388969421, 'coordinate': [35.273826599121094, 19.851961135864258, 358.9250793457031, 77.81258392333984]}, {'cls_id': 0, 'label': 'paragraph_title', 'score': 0.8755733966827393, 'coordinate': [386.6318359375, 476.6071472167969, 699.783447265625, 490.11639404296875]}, {'cls_id': 0, 'label': 'paragraph_title', 'score': 0.8617452383041382, 'coordinate': [387.27447509765625, 715.9579467773438, 524.3836669921875, 729.2079467773438]}, {'cls_id': 0, 'label': 'paragraph_title', 'score': 0.8607752919197083, 'coordinate': [35.45162582397461, 627.4959716796875, 185.63442993164062, 640.4028930664062]}, {'cls_id': 0, 'label': 'paragraph_title', 'score': 0.8575425148010254, 'coordinate': [35.33491134643555, 330.8046875, 141.46853637695312, 344.40728759765625]}, {'cls_id': 9, 'label': 'table_title', 'score': 0.7957680225372314, 'coordinate': [385.9385986328125, 19.754547119140625, 711.5118408203125, 75.00630950927734]}]}}

```

参数含义如下:

- `input_path`:输入的待预测图像的路径

- `boxes`:预测的目标框信息,一个字典列表。每个字典代表一个检出的目标,包含以下信息:

- `cls_id`:类别ID,一个整数

- `label`:类别标签,一个字符串

- `score`:目标框置信度,一个浮点数

- `coordinate`:目标框坐标,一个浮点数列表,格式为[xmin, ymin, xmax, ymax]

相关方法、参数等说明如下:

* `create_model`实例化目标检测模型(此处以`PP-DocLayout-L`为例),具体说明如下:

相关方法、参数等说明如下:

* `create_model`实例化目标检测模型(此处以`PP-DocLayout-L`为例),具体说明如下:

| 参数 |

参数说明 |

参数类型 |

可选项 |

默认值 |

model_name |

模型名称 |

str |

无 |

无 |

model_dir |

模型存储路径 |

str |

无 |

无 |

img_size |

输入图像大小;如果不指定,将默认使用PaddleX官方模型配置 |

int/list/None |

- int, 如 640 , 表示将输入图像resize到640x640大小

- 列表, 如 [640, 512] , 表示将输入图像resize到宽为640,高为512大小

- None, 不指定,将默认使用PaddleX官方模型配置

|

None |

threshold |

用于过滤掉低置信度预测结果的阈值;如果不指定,将默认使用PaddleX官方模型配置 |

float/dict/None |

- float,如 0.2, 表示过滤掉所有阈值小于0.2的目标框

- 字典,字典的key为int类型,代表

cls_id,val为float类型阈值。如 {0: 0.45, 2: 0.48, 7: 0.4},表示对cls_id为0的类别应用阈值0.45、cls_id为1的类别应用阈值0.48、cls_id为7的类别应用阈值0.4

- None, 不指定,将默认使用PaddleX官方模型配置

|

None |

layout_nms |

是否使用NMS后处理,过滤重叠框;如果不指定,将默认使用PaddleX官方模型配置 |

bool/None |

- bool, True/False , 表示使用/不使用NMS进行检测框的后处理过滤重叠框

- None, 不指定,将默认使用PaddleX官方模型配置

|

None |

layout_unclip_ratio |

检测框的边长缩放倍数;如果不指定,将默认使用PaddleX官方模型配置 |

float/list/None |

- float, 大于0的浮点数,如 1.1 , 表示将模型输出的检测框中心不变,宽和高都扩张1.1倍

- 列表, 如 [1.2, 1.5] , 表示将模型输出的检测框中心不变,宽度扩张1.2倍,高度扩张1.5倍

- None, 不指定,将默认使用PaddleX官方模型配置

|

layout_merge_bboxes_mode |

模型输出的检测框的合并处理模式;如果不指定,将默认使用PaddleX官方模型配置 |

string/None |

- large, 设置为large时,表示在模型输出的检测框中,对于互相重叠包含的检测框,只保留外部最大的框,删除重叠的内部框。

- small, 设置为small,表示在模型输出的检测框中,对于互相重叠包含的检测框,只保留内部被包含的小框,删除重叠的外部框。

- union, 不进行框的过滤处理,内外框都保留

- None, 不指定,将默认使用PaddleX官方模型配置

|

None |

* 其中,`model_name` 必须指定,指定 `model_name` 后,默认使用 PaddleX 内置的模型参数,在此基础上,指定 `model_dir` 时,使用用户自定义的模型。

* 调用目标检测模型的 `predict()` 方法进行推理预测,`predict()` 方法参数有 `input`、`batch_size`和`threshold`,具体说明如下:

| 参数 |

参数说明 |

参数类型 |

可选项 |

默认值 |

input |

待预测数据,支持多种输入类型 |

Python Var/str/dict/list |

- Python变量,如

numpy.ndarray表示的图像数据

- 文件路径,如图像文件的本地路径:

/root/data/img.jpg

- URL链接,如图像文件的网络URL:示例

- 本地目录,该目录下需包含待预测数据文件,如本地路径:

/root/data/

- 字典,字典的

key需与具体任务对应,如图像分类任务对应\"img\",字典的val支持上述类型数据,例如:{\"img\": \"/root/data1\"}

- 列表,列表元素需为上述类型数据,如

[numpy.ndarray, numpy.ndarray],[\"/root/data/img1.jpg\", \"/root/data/img2.jpg\"],[\"/root/data1\", \"/root/data2\"],[{\"img\": \"/root/data1\"}, {\"img\": \"/root/data2/img.jpg\"}]

|

无 |

batch_size |

批大小 |

int |

大于0的任意整数 |

1 |

threshold |

用于过滤掉低置信度预测结果的阈值 |

float/dict/None |

- float,如 0.2, 表示过滤掉所有阈值小于0.2的目标框

- 字典,字典的key为int类型,代表

cls_id,val为float类型阈值。如 {0: 0.45, 2: 0.48, 7: 0.4},表示对cls_id为0的类别应用阈值0.45、cls_id为1的类别应用阈值0.48、cls_id为7的类别应用阈值0.4

- None, 不指定,将默认使用

creat_model 指定的 threshold 参数,如果 creat_model 也没有指定,则默认使用PaddleX官方模型配置

|

layout_nms |

是否使用NMS后处理,过滤重叠框;如果不指定,将默认使用PaddleX官方模型配置 |

bool/None |

- bool, True/False , 表示使用/不使用NMS进行检测框的后处理过滤重叠框

- None, 不指定,将默认使用

creat_model 指定的 layout_nms 参数,如果 creat_model 也没有指定,则默认使用PaddleX官方模型配置

|

None |

layout_unclip_ratio |

检测框的边长缩放倍数;如果不指定,将默认使用PaddleX官方模型配置 |

float/list/None |

- float, 大于0的浮点数,如 1.1 , 表示将模型输出的检测框中心不变,宽和高都扩张1.1倍

- 列表, 如 [1.2, 1.5] , 表示将模型输出的检测框中心不变,宽度扩张1.2倍,高度扩张1.5倍

- None, 不指定,将默认使用

creat_model 指定的 layout_unclip_ratio 参数,如果 creat_model 也没有指定,则默认使用PaddleX官方模型配置

|

layout_merge_bboxes_mode |

模型输出的检测框的合并处理模式;如果不指定,将默认使用PaddleX官方模型配置 |

string/None |

- large, 设置为large时,表示在模型输出的检测框中,对于互相重叠包含的检测框,只保留外部最大的框,删除重叠的内部框。

- small, 设置为small,表示在模型输出的检测框中,对于互相重叠包含的检测框,只保留内部被包含的小框,删除重叠的外部框。

- union, 不进行框的过滤处理,内外框都保留

- None, 不指定,将默认使用

creat_model 指定的 layout_merge_bboxes_mode 参数,如果 creat_model 也没有指定,则默认使用PaddleX官方模型配置

|

无 |

* 对预测结果进行处理,每个样本的预测结果均为`dict`类型,且支持打印、保存为图片、保存为`json`文件的操作:

| 方法 |

方法说明 |

参数 |

参数类型 |

参数说明 |

默认值 |

print() |

打印结果到终端 |

format_json |

bool |

是否对输出内容进行使用 JSON 缩进格式化 |

True |

indent |

int |

指定缩进级别,以美化输出的 JSON 数据,使其更具可读性,仅当 format_json 为 True 时有效 |

4 |

ensure_ascii |

bool |

控制是否将非 ASCII 字符转义为 Unicode。设置为 True 时,所有非 ASCII 字符将被转义;False 则保留原始字符,仅当format_json为True时有效 |

False |

save_to_json() |

将结果保存为json格式的文件 |

save_path |

str |

保存的文件路径,当为目录时,保存文件命名与输入文件类型命名一致 |

无 |

indent |

int |

指定缩进级别,以美化输出的 JSON 数据,使其更具可读性,仅当 format_json 为 True 时有效 |

4 |

ensure_ascii |

bool |

控制是否将非 ASCII 字符转义为 Unicode。设置为 True 时,所有非 ASCII 字符将被转义;False 则保留原始字符,仅当format_json为True时有效 |

False |

save_to_img() |

将结果保存为图像格式的文件 |

save_path |

str |

保存的文件路径,当为目录时,保存文件命名与输入文件类型命名一致 |

无 |

* 此外,也支持通过属性获取带结果的可视化图像和预测结果,具体如下:

| 属性 |

属性说明 |

json |

获取预测的json格式的结果 |

img |

获取格式为dict的可视化图像 |

关于更多 PaddleX 的单模型推理的 API 的使用方法,可以参考的使用方法,可以参考[PaddleX单模型Python脚本使用说明](../../instructions/model_python_API.md)。

## 四、二次开发

如果你追求更高精度的现有模型,可以使用PaddleX的二次开发能力,开发更好的版面区域定位模型。在使用PaddleX开发版面区域定位模型之前,请务必安装PaddleX的Detection相关的模型训练能力,安装过程可以参考[PaddleX本地安装教程](../../../installation/installation.md)。

### 4.1 数据准备

在进行模型训练前,需要准备相应任务模块的数据集。PaddleX 针对每一个模块提供了数据校验功能,只有通过数据校验的数据才可以进行模型训练。此外,PaddleX为每一个模块都提供了Demo数据集,您可以基于官方提供的 Demo 数据完成后续的开发。若您希望用私有数据集进行后续的模型训练,可以参考[PaddleX目标检测任务模块数据标注教程](../../../data_annotations/cv_modules/object_detection.md)。

#### 4.1.1 Demo 数据下载

您可以参考下面的命令将 Demo 数据集下载到指定文件夹:

```bash

cd /path/to/paddlex

wget https://paddle-model-ecology.bj.bcebos.com/paddlex/data/det_layout_examples.tar -P ./dataset

tar -xf ./dataset/det_layout_examples.tar -C ./dataset/

```

#### 4.1.2 数据校验

一行命令即可完成数据校验:

```bash

python main.py -c paddlex/configs/modules/layout_detection/PicoDet-L_layout_3cls.yaml \

-o Global.mode=check_dataset \

-o Global.dataset_dir=./dataset/det_layout_examples

```

执行上述命令后,PaddleX 会对数据集进行校验,并统计数据集的基本信息,命令运行成功后会在log中打印出`Check dataset passed !`信息。校验结果文件保存在`./output/check_dataset_result.json`,同时相关产出会保存在当前目录的`./output/check_dataset`目录下,产出目录中包括可视化的示例样本图片和样本分布直方图。

👉 校验结果详情(点击展开)

校验结果文件具体内容为:

{

"done_flag": true,

"check_pass": true,

"attributes": {

"num_classes": 11,

"train_samples": 90,

"train_sample_paths": [

"check_dataset/demo_img/JPEGImages/train_0077.jpg",

"check_dataset/demo_img/JPEGImages/train_0028.jpg",

"check_dataset/demo_img/JPEGImages/train_0012.jpg"

],

"val_samples": 20,

"val_sample_paths": [

"check_dataset/demo_img/JPEGImages/val_0007.jpg",

"check_dataset/demo_img/JPEGImages/val_0019.jpg",

"check_dataset/demo_img/JPEGImages/val_0010.jpg"

]

},

"analysis": {

"histogram": "check_dataset/histogram.png"

},

"dataset_path": "./dataset/example_data/det_layout_examples",

"show_type": "image",

"dataset_type": "COCODetDataset"

}

上述校验结果中,check_pass 为 True 表示数据集格式符合要求,其他部分指标的说明如下:

attributes.num_classes:该数据集类别数为11;attributes.train_samples:该数据集训练集样本数量为90;attributes.val_samples:该数据集验证集样本数量为 20;attributes.train_sample_paths:该数据集训练集样本可视化图片相对路径列表;attributes.val_sample_paths:该数据集验证集样本可视化图片相对路径列表;

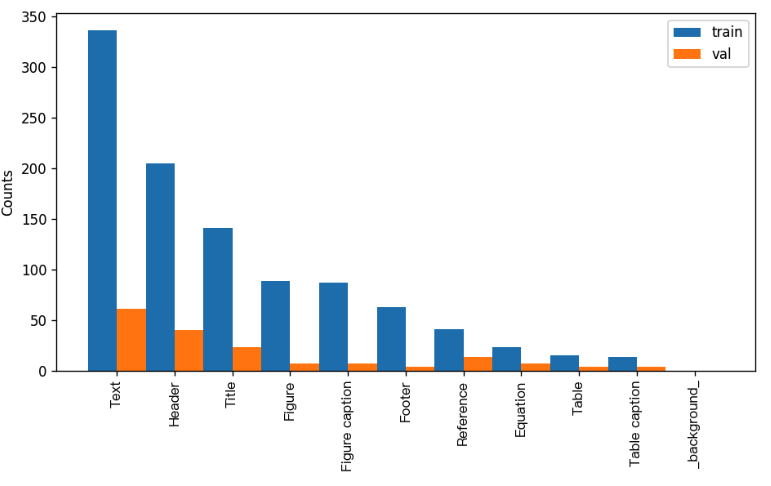

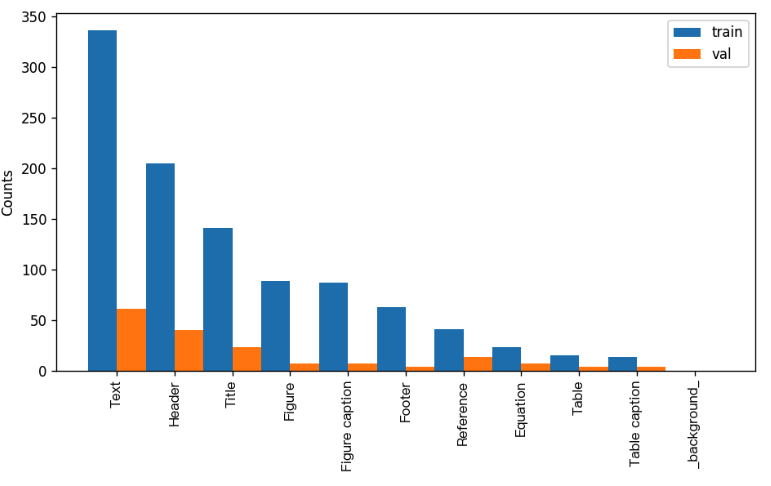

数据集校验还对数据集中所有类别的样本数量分布情况进行了分析,并绘制了分布直方图(histogram.png):

👉 格式转换/数据集划分详情(点击展开)

(1)数据集格式转换

版面区域检测暂不支持数据格式转换。

(2)数据集划分

数据集划分的参数可以通过修改配置文件中 CheckDataset 下的字段进行设置,配置文件中部分参数的示例说明如下:

CheckDataset:split:enable: 是否进行重新划分数据集,为 True 时进行数据集格式转换,默认为 False;train_percent: 如果重新划分数据集,则需要设置训练集的百分比,类型为0-100之间的任意整数,需要保证与 val_percent 的值之和为100;

例如,您想重新划分数据集为 训练集占比90%、验证集占比10%,则需将配置文件修改为:

......

CheckDataset:

......

split:

enable: True

train_percent: 90

val_percent: 10

......

随后执行命令:

python main.py -c paddlex/configs/modules/layout_detection/PicoDet-L_layout_3cls.yaml \

-o Global.mode=check_dataset \

-o Global.dataset_dir=./dataset/det_layout_examples

数据划分执行之后,原有标注文件会被在原路径下重命名为 xxx.bak。

以上参数同样支持通过追加命令行参数的方式进行设置:

python main.py -c paddlex/configs/modules/layout_detection/PicoDet-L_layout_3cls.yaml \

-o Global.mode=check_dataset \

-o Global.dataset_dir=./dataset/det_layout_examples \

-o CheckDataset.split.enable=True \

-o CheckDataset.split.train_percent=90 \

-o CheckDataset.split.val_percent=10

👉 更多说明(点击展开)

👉 更多说明(点击展开)

在模型评估时,需要指定模型权重文件路径,每个配置文件中都内置了默认的权重保存路径,如需要改变,只需要通过追加命令行参数的形式进行设置即可,如-o Evaluate.weight_path=``./output/best_model/best_model/model.pdparams。

在完成模型评估后,会产出evaluate_result.json,其记录了评估的结果,具体来说,记录了评估任务是否正常完成,以及模型的评估指标,包含 AP;

相关方法、参数等说明如下:

* `create_model`实例化目标检测模型(此处以`PP-DocLayout-L`为例),具体说明如下:

相关方法、参数等说明如下:

* `create_model`实例化目标检测模型(此处以`PP-DocLayout-L`为例),具体说明如下: