deploy_cpp_win_vs2019.md 4.8 KB

Visual Studio 2019 Community CMake 编译指南

Windows 平台下,我们使用Visual Studio 2019 Community 进行了测试。微软从Visual Studio 2017开始即支持直接管理CMake跨平台编译项目,但是直到2019才提供了稳定和完全的支持,所以如果你想使用CMake管理项目编译构建,我们推荐你使用Visual Studio 2019环境下构建。

前置条件

- Visual Studio 2019

- CUDA 9.0 / CUDA 10.0, CUDNN 7+ (仅在使用GPU版本的预测库时需要)

- CMake 3.0+

请确保系统已经安装好上述基本软件,我们使用的是VS2019的社区版。

下面所有示例以工作目录为 D:\projects演示。

Step1: 下载代码

下载源代码

git clone https://github.com/PaddlePaddle/PaddleX.git

说明:其中C++预测代码在PaddleX/deploy/cpp 目录,该目录不依赖任何PaddleX下其他目录。

Step2: 下载PaddlePaddle C++ 预测库 fluid_inference

PaddlePaddle C++ 预测库针对不同的CPU和CUDA版本提供了不同的预编译版本,请根据实际情况下载: C++预测库下载列表

解压后D:\projects\fluid_inference目录包含内容为:

fluid_inference

├── paddle # paddle核心库和头文件

|

├── third_party # 第三方依赖库和头文件

|

└── version.txt # 版本和编译信息

Step3: 安装配置OpenCV

- 在OpenCV官网下载适用于Windows平台的3.4.6版本, 下载地址

- 运行下载的可执行文件,将OpenCV解压至指定目录,如

D:\projects\opencv - 配置环境变量,如下流程所示

- 我的电脑->属性->高级系统设置->环境变量

- 在系统变量中找到Path(如没有,自行创建),并双击编辑

- 新建,将opencv路径填入并保存,如

D:\projects\opencv\build\x64\vc14\bin

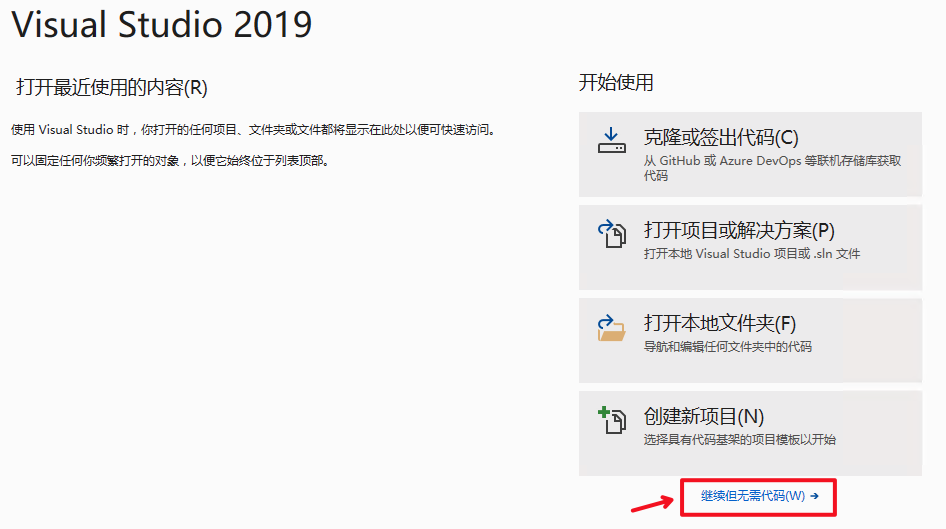

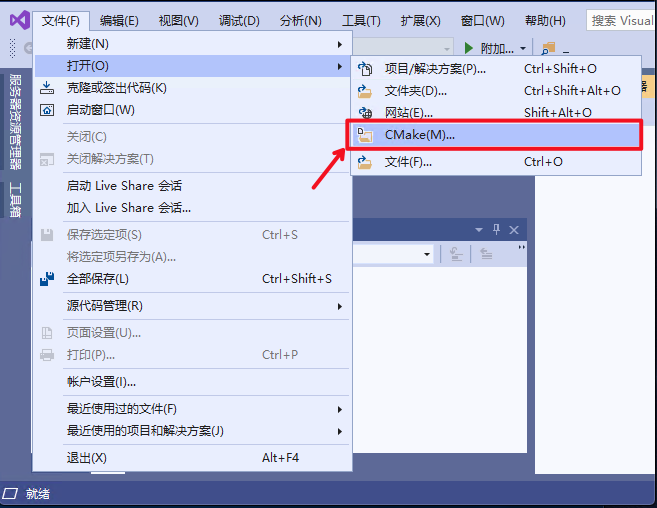

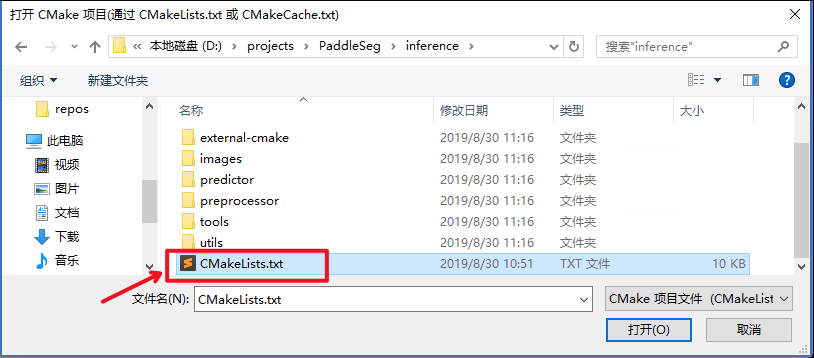

Step4: 使用Visual Studio 2019直接编译CMake

选择项目代码所在路径,并打开CMakeList.txt:

- 点击:

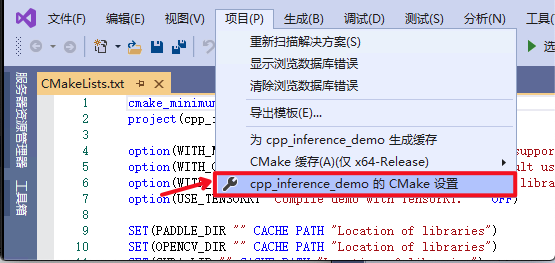

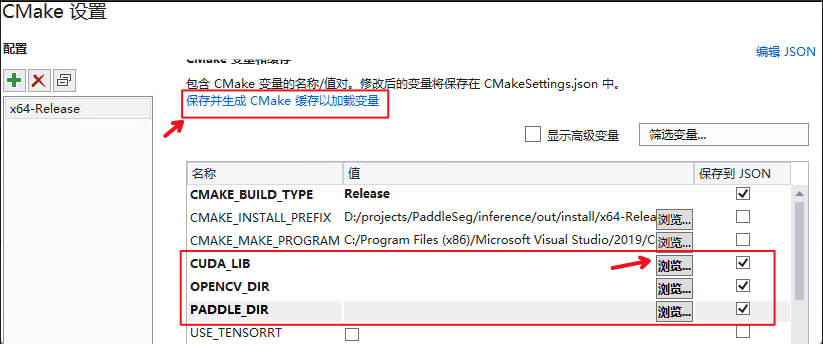

项目->cpp_inference_demo的CMake设置

- 点击

浏览,分别设置编译选项指定CUDA、OpenCV、Paddle预测库的路径

三个编译参数的含义说明如下(带*表示仅在使用GPU版本预测库时指定, 其中CUDA库版本尽量对齐,使用9.0、10.0版本,不使用9.2、10.1等版本CUDA库):

| 参数名 | 含义 |

|---|---|

| *CUDA_LIB | CUDA的库路径 |

| OPENCV_DIR | OpenCV的安装路径, |

| PADDLE_DIR | Paddle预测库的路径 |

注意: 1. 使用CPU版预测库,请把WITH_GPU的勾去掉 2. 如果使用的是openblas版本,请把WITH_MKL勾去掉

设置完成后, 点击上图中保存并生成CMake缓存以加载变量。

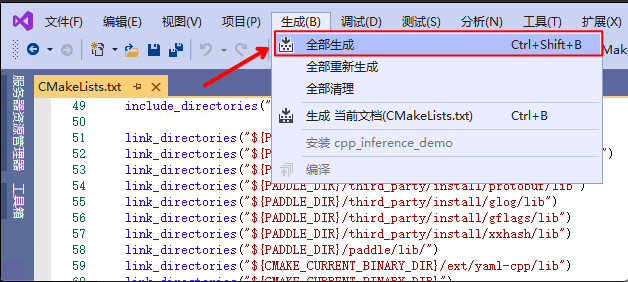

- 点击

生成->全部生成

Step5: 预测及可视化

上述Visual Studio 2019编译产出的可执行文件在out\build\x64-Release目录下,打开cmd,并切换到该目录:

cd D:\projects\PaddleX\inference\out\build\x64-Release

编译成功后,预测demo的入口程序为detector,classifer,segmenter,其主要命令参数说明如下:

| 参数 | 说明 |

|---|---|

| model_dir | 导出的预测模型所在路径 |

| image | 要预测的图片文件路径 |

| image_list | 按行存储图片路径的.txt文件 |

| use_gpu | 是否使用 GPU 预测, 支持值为0或1(默认值为0) |

| gpu_id | GPU 设备ID, 默认值为0 |

| save_dir | 保存可视化结果的路径, 默认值为"output",classfier无该参数 |

样例一:

不使用GPU测试图片 D:\\images\\test.jpeg

./detector --model_dir=D:\\models\\yolov3_darknet --image=D:\\images\\test.jpeg

图片文件可视化预测结果会保存在save_dir参数设置的目录下。

样例二:

使用GPU预测多个图片D:\\images\\image_list.txt,image_list.txt内容的格式如下:

D:\\images\\test.jpeg

D:\\images\\test1.jpeg

...

D:\\images\\testn.jpeg

./detector --model_dir=D:\\models\\yolov3_darknet --image_list=D:\\images\\images_list.txt --use_gpu=1

图片文件可视化预测结果会保存在save_dir参数设置的目录下。